Il s'agit d'une installation unique en son genre destinée à aider les entités gouvernementales des Émirats arabes unis et les organisations du secteur privé à tester, valider et certifier les modèles, agents et applications d'IA en termes de sécurité, de sûreté et de fiabilité.

Il s'agit d'une installation unique en son genre destinée à aider les entités gouvernementales des Émirats arabes unis et les organisations du secteur privé à tester, valider et certifier les modèles, agents et applications d'IA en termes de sécurité, de sûreté et de fiabilité.

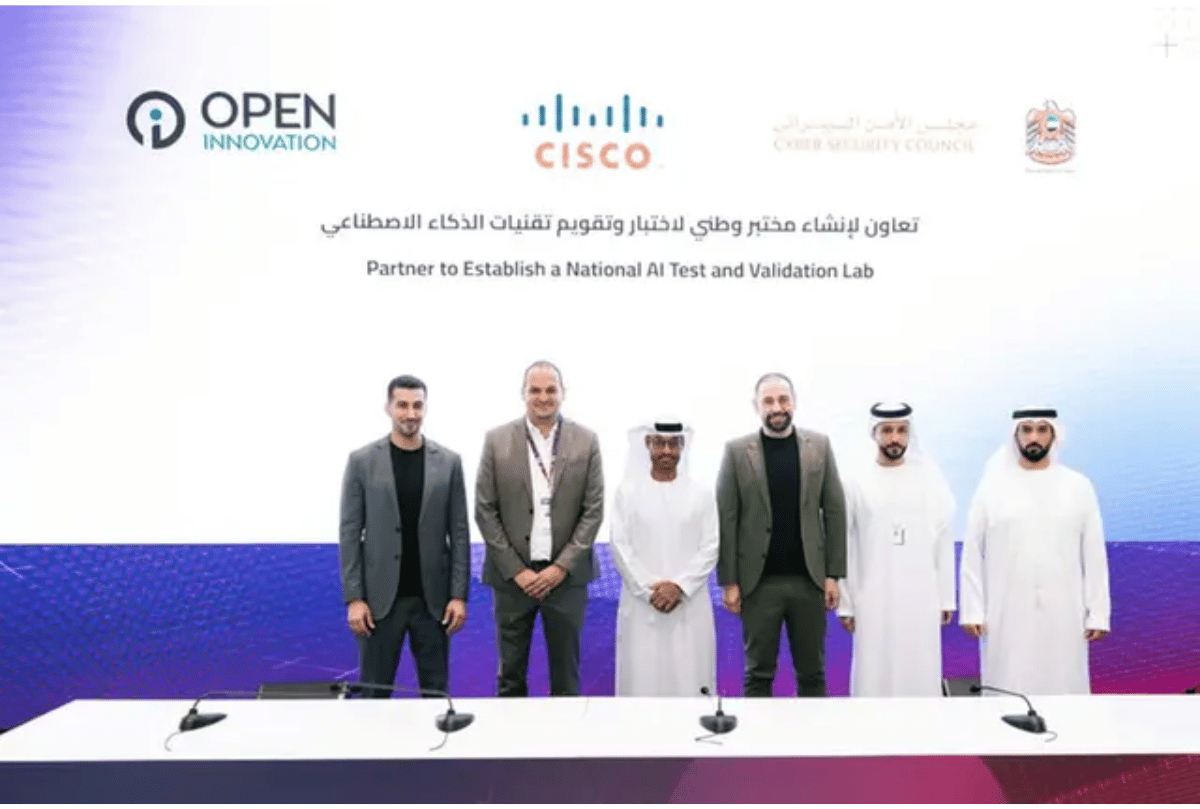

Les Émirats arabes unis établissent une nouvelle référence mondiale pour l’adoption sécurisée et responsable de l’intelligence artificielle (IA). Alors que le pays accélère l'adoption de l'IA, le Conseil de cybersécurité (CSC) des Émirats arabes unis, IA d'innovation ouverte, et Cisco, travaillant en collaboration stratégique avec Emircom, a annoncé la création du laboratoire national de test et de validation de l'IA. Il s'agit d'une installation unique en son genre destinée à aider les entités gouvernementales des Émirats arabes unis et les organisations du secteur privé à tester, valider et certifier les modèles, agents et applications d'IA en termes de sécurité, de sûreté et de fiabilité.

« L'intelligence artificielle fait désormais partie du tissu des services gouvernementaux, des infrastructures critiques et de la vie quotidienne aux Émirats arabes unis. Le laboratoire national de test et de validation de l'IA offre au pays une capacité souveraine pour garantir que chaque modèle d'IA et chaque agent d'IA déployé dans notre économie est sécurisé, digne de confiance et aligné sur nos politiques nationales. C'est ainsi que nous transformons l'ambition des Émirats arabes unis d'être leader en matière d'IA en une assurance concrète et vérifiable pour nos citoyens. «

– SEM Mohamed Al-Kuwaiti, Chef de la cybersécurité du gouvernement des Émirats arabes unis et président du Conseil de cybersécurité des Émirats arabes unis

Un environnement souverain pour la sécurité de l'IA

Hébergé aux Émirats arabes unis et exploité sous la gouvernance du Conseil de cybersécurité, le laboratoire est conçu dans le but de permettre des déploiements d'IA alignés sur les politiques de cybersécurité des Émirats arabes unis liées à l'IA, au cloud et aux infrastructures d'informations critiques. De plus, il vise à évaluer la conformité des modèles par rapport aux normes internationales telles que ISO 42001, MITRE ATLAS, NIST AI RMF et les cadres OWASP pour les LLM et les agents d'IA.

Cadre d'évaluation global

Le laboratoire propose une évaluation complète des systèmes d’IA visant à garantir les normes de fiabilité les plus élevées. Les évaluations couvrent :

- Sécurité du modèle : Tests de robustesse et de sécurité.

- Défense contre les menaces : Identifier les vulnérabilités telles que les tentatives d'injection rapide et de jailbreak.

- Intégrité des données : Surveillance des fuites de données et des risques liés à la confidentialité.

- Sécurité de la chaîne d'approvisionnement : Vérifier l'intégrité des modèles et des poids.

- Autonomie des agents : Évaluation des risques associés à l'utilisation des outils des agents.

- Conformité réglementaire : Assurer l’alignement avec les mandats des Émirats arabes unis en matière d’IA, de cloud et de cybersécurité.

Les systèmes qui réussissent ces évaluations recevront une marque de certification nationale. Cela donne aux régulateurs, aux opérateurs et aux citoyens l’assurance claire que le système d’IA est sécurisé et vérifié.

« À l'ère de l'IA, la sécurité ne peut pas être une réflexion après coup ; elle doit être intégrée dans toutes les infrastructures. Notre collaboration avec le Conseil de cybersécurité des Émirats arabes unis et Open Innovation AI marque un moment crucial pour assurer l'avenir de l'économie numérique des Émirats arabes unis. En combinant notre infrastructure sécurisée et prête pour l'IA avec la vision réglementaire proactive des Émirats arabes unis, nous créons un modèle mondial pour un écosystème d'IA résilient par conception, protégé à grande échelle et intrinsèquement digne de confiance. «

– Fady Younes, directeur général de la cybersécurité chez Cisco Moyen-Orient, Turquie, Afrique, Roumanie et CEI

« Sécuriser l'IA ne peut pas être un exercice ponctuel, les modèles évoluent, les agents agissent de manière autonome et de nouvelles techniques d'attaque émergent chaque semaine. Avec le Conseil de cybersécurité des Émirats arabes unis et Cisco, nous industrialisons la sécurité de l'IA : nous regroupons, testons et certifions en permanence les systèmes d'IA à une échelle qui correspond à la rapidité avec laquelle ils sont déployés. Nous espérons que le laboratoire analysera des dizaines à des centaines de milliers d'agents par an, et nous sommes fiers de mettre notre plateforme au service de la mission nationale des Émirats arabes unis. «

– Dr Abed Benaichouche, directeur général, Open Innovation AI

Une pile technologique unifiée

Le Lab repose sur une base haute performance conçue pour évoluer. En combinant l'infrastructure sécurisée de Cisco avec le logiciel d'Open Innovation AI, le laboratoire est conçu dans le but d'automatiser la conformité aux politiques et la collecte de preuves.

Les composants clés comprennent :

- Infrastructure Cisco prête pour l'IA : Réseau sécurisé et calcul hautes performances alimentés par les GPU NVIDIA.

- Responsable du pôle d'innovation ouverte (OICM) : Orchestre les charges de travail d’IA de bout en bout.

- Sécurité OI AI et défense Cisco AI : Fournit une équipe rouge complète et des tests automatisés.

Opérationnel à grande échelle

Le Lab est déjà opérationnel. Au cours des prochains mois, l'installation vise à évoluer pour analyser des dizaines de milliers d'agents d'IA chaque année, soutenant ainsi l'adoption rapide de l'IA agentique par les Émirats arabes unis.

Ouvert au gouvernement et à l'industrie

Le laboratoire servira les entités gouvernementales fédérales et locales, les opérateurs d'infrastructures nationales critiques, les services financiers, les soins de santé, l'énergie et les télécommunications, ainsi que les développeurs d'IA basés aux Émirats arabes unis qui cherchent à démontrer que leurs modèles et agents répondent aux exigences nationales avant d'être mis sur le marché.